تنتج الذكاء الاصطناعي (AI) “توائم رقمية” سريالية مثل السياسيين والمشاهير والمواد الإباحية.

أخبر الدكتور إريك كول ، وهو وكيل سابق في وكالة المخابرات المركزية وخبير الأمن السيبراني ، Fox News Digital أن ممارسات الخصوصية الضعيفة عبر الإنترنت واستعداد الناس لنشر المعلومات على وسائل التواصل الاجتماعي عرضة ل AI Deepfakes.

وقال “القط لم يخرج من الحقيبة بعد الآن”.

“لديهم صورنا ، ويعرفون أطفالنا ، وهم يعرفون عائلاتنا. إنهم يعرفون المكان الذي نعيش فيه. والآن ، إلى جانب الذكاء الاصطناعى ، يمكنهم أخذ جميع البيانات حول من نحن ، وكيف ننظر ، وكيف نتصرف ، وبشكل أساسي يمكننا إنشاء توأم رقمي” ، تابع كول.

ضع هذه النصائح في الاعتبار ولا تنخدع بها DeepFakes التي تم إنشاؤها بواسطة AI

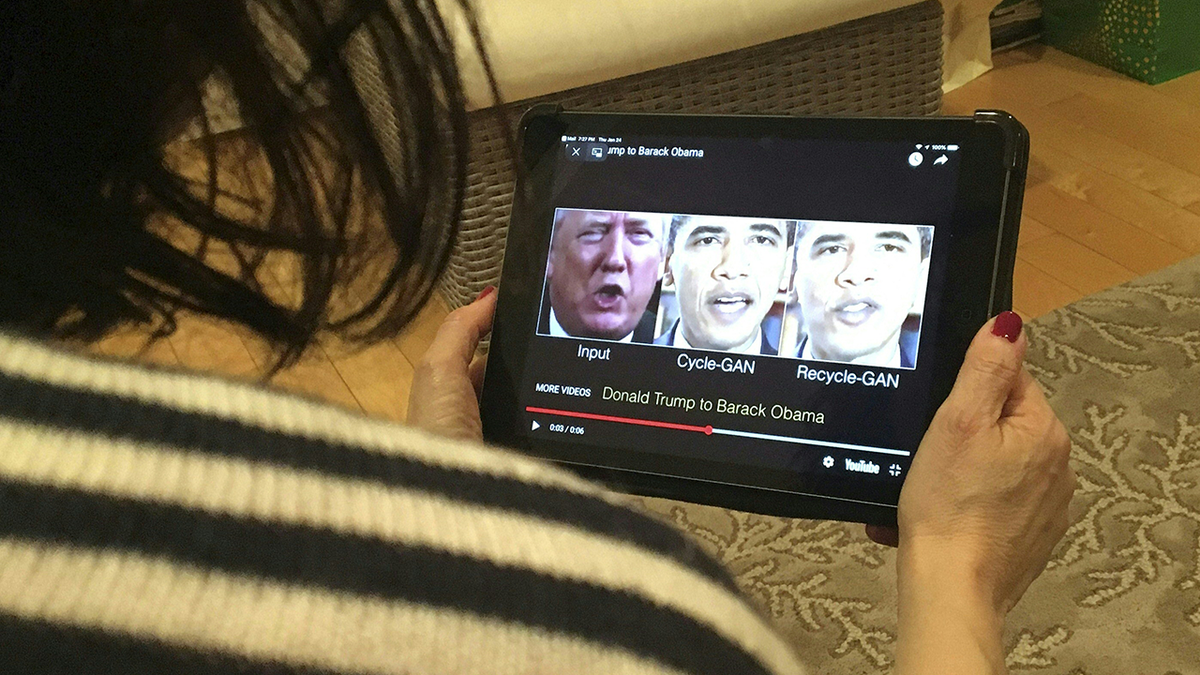

غالبًا ما تتضمن الصور التي تم إنشاؤها بواسطة AI ، والمعروفة باسم “Deepfakes” ، تحرير مقاطع الفيديو أو الصور لجعلها تبدو مثل الآخرين ، أو استخدام صوتك لإدلاء بيان لم تتحدث به أبدًا في الحياة الواقعية. (Elyse Samuels/The Washington Post/Lane Turner/The Boston Globe/Stefani Reynolds/AFP

وقال إن التوأم الرقمي جيد لدرجة أنه من الصعب نقل الفرق بين النسخة الاصطناعية والشخص الحقيقي الذي يستند إليه DeepFark.

في الشهر الماضي ، تم توزيع مقطع صوتي احتيالي لدونالد ترامب جونيور ، مما يشير إلى أنه ينبغي على الولايات المتحدة إرسال المعدات العسكرية إلى روسيا بدلاً من أوكرانيا.

دعامات تمت مناقشته على نطاق واسع على وسائل التواصل الاجتماعي وبدا وكأنه مقطع من حلقة من البودكاست ، “دونالد ترامب جونيور و TRIGGER”.

أكد خبراء التحليلات الرقمية في وقت لاحق أن السجل الصوتي لـ Trump Jr. قد تم إنشاؤه باستخدام الذكاء الاصطناعى ، مشيرين إلى أن التكنولوجيا أصبحت أكثر “ماهرًا وصقلًا”.

FactPostNews ، و حساب الديمقراطيين الرسميين ، تم نشر الصوت مثل الشيء الحقيقي. الحساب في وقت لاحق حذف التسجيل. شرح آخر ، الجمهوريون ضد ترامب نشروا أيضا مقطع.

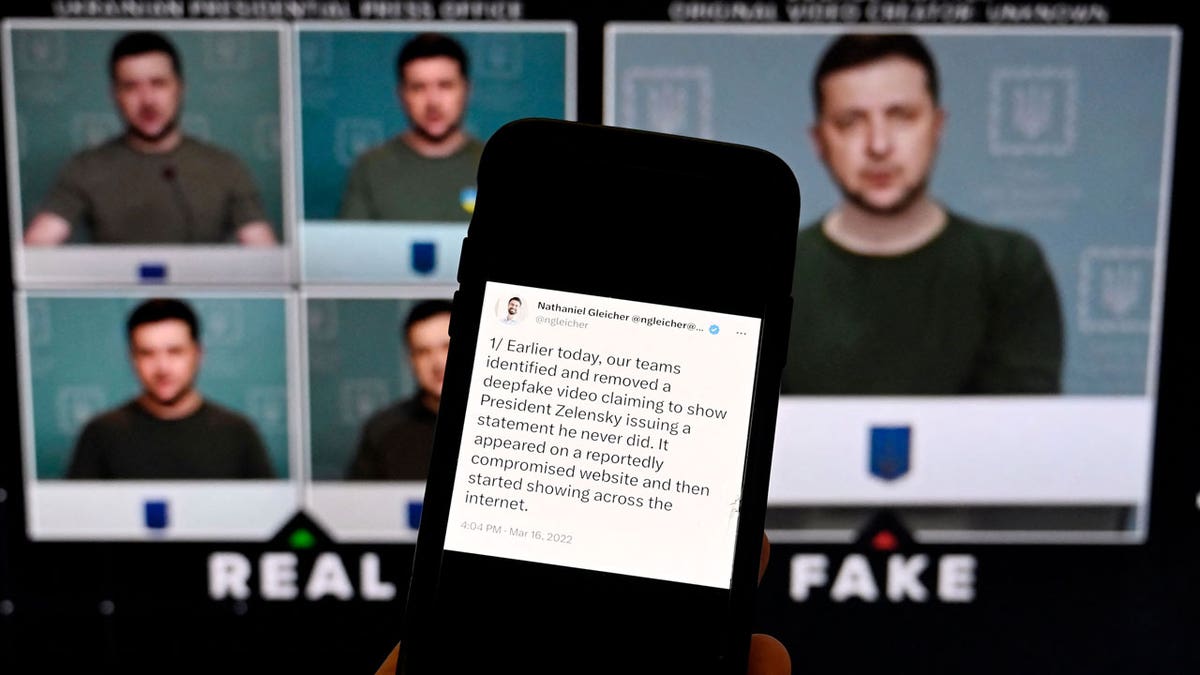

على مدار السنوات القليلة الماضية ، تم استخدام العديد من الأمثلة على AI Deepfake لتضليل المشاهدين المشاركين في المحتوى السياسي. أظهر مقطع الفيديو لعام 2022 ما يشبه الرئيس الأوكراني فولدي مي زيلنسكي الذي يستسلم لروسيا ، لكن المقاطع المزيفة لم يتم تصنيعها وانتشرت بشكل مؤقت عبر الإنترنت.

ظهرت مقاطع الفيديو التي تمت معالجتها للرئيس دونالد ترامب والرئيس السابق جو بايدن استعدادًا للانتخابات الرئاسية الأمريكية لعام 2024. استنادًا إلى مقاطع الفيديو الموجودة ، غالبًا ما غيرت هذه المقاطع كلمات وسلوكيات ترامب وبيدن.

الاباحية التي تم إنشاؤها من الذكاء الاصطناعى التي تحتوي على عراة مزيفة من المشاهير تلتصق بإيتسي كقانون عميق “تأخر”

تشاهد امرأة من واشنطن العاصمة مقطع فيديو تم تشغيله في 24 يناير 2019. هذا يغير ما يقاله الرئيس دونالد ترامب والرئيس السابق باراك أوباما ، مما يدل على مدى تطور تكنولوجيا Deepfake. (روب ريفر/AFP عبر Getty Images)

غالبًا ما تتضمن الصور التي تم إنشاؤها بواسطة AI ، والمعروفة باسم “Deepfakes” ، تحرير مقاطع الفيديو والصور لاستخدام الذكاء الاصطناعي لجعلها تبدو مثل الآخرين. ضرب Deepfakes الرادار العام في عام 2017 بعد أن نشر مستخدمو Reddit إباحية واقعية المظهر من المشاهير إلى المنصة ، وذلك باستخدام منظمة العفو الدولية لجعل الصور تبدو أكثر إقناعا ، ونتيجة لذلك ، فتح القفل لضمان مشاركتها على نطاق واسع في العام التالي.

أخبر كول فوكس نيوز الرقمي أنه “أسوأ عدو له” حول AI Deepfakes ، وقد يكون الحد من التعرض عبر الإنترنت هو أفضل طريقة لتجنب أن تصبح ضحية.

ومع ذلك ، في السياسة ووسائل الإعلام حيث “الرؤية مهمة” هي الأرقام العامة هي الأهداف الرئيسية لاستخدام الذكاء الاصطناعي الخبيث. لدى الجهات الفاعلة للتهديدات المهتمة بتكرار الرئيس ترامب الكثير من الأعلاف لإنتاج بيانات مص المزدوجة الرقمية للقادة الأمريكيين في مجموعة متنوعة من الإعدادات.

يجب أن يتوقف الكونغرس عن أدوات الذكاء الاصطناعى الجديدة المستخدمة لاستغلال الأطفال

“مقاطع الفيديو التي يمكنني ركوبها ، وكيف يسير ، وكيف يتصرف ، وكيف يتصرف ، يمكنني إطعامها لنموذج الذكاء الاصطناعى وجعلها عميقة واقعية مثل الرئيس ترامب.

بالإضافة إلى افتراض المسؤولية الشخصية عن إزالة البيانات الشخصية عبر الإنترنت ، قال كول إن القانون يمكن أن يكون وسيلة أخرى للحد من الاستخدام غير المناسب لمنظمة العفو الدولية.

تيد كروزنز من R-Texas. Tedcruz ، و D-Minn. قدمت إيمي كلوبوتشار مؤخرًا قانون Take It Down. مرت مشروع القانون بالإجماع من خلال مجلس الشيوخ في أوائل عام 2025 ، وقال كروز إنه يعتقد أنه سيتم تمريره في مجلس النواب قبل أن يصبح قانونًا في أوائل مارس.

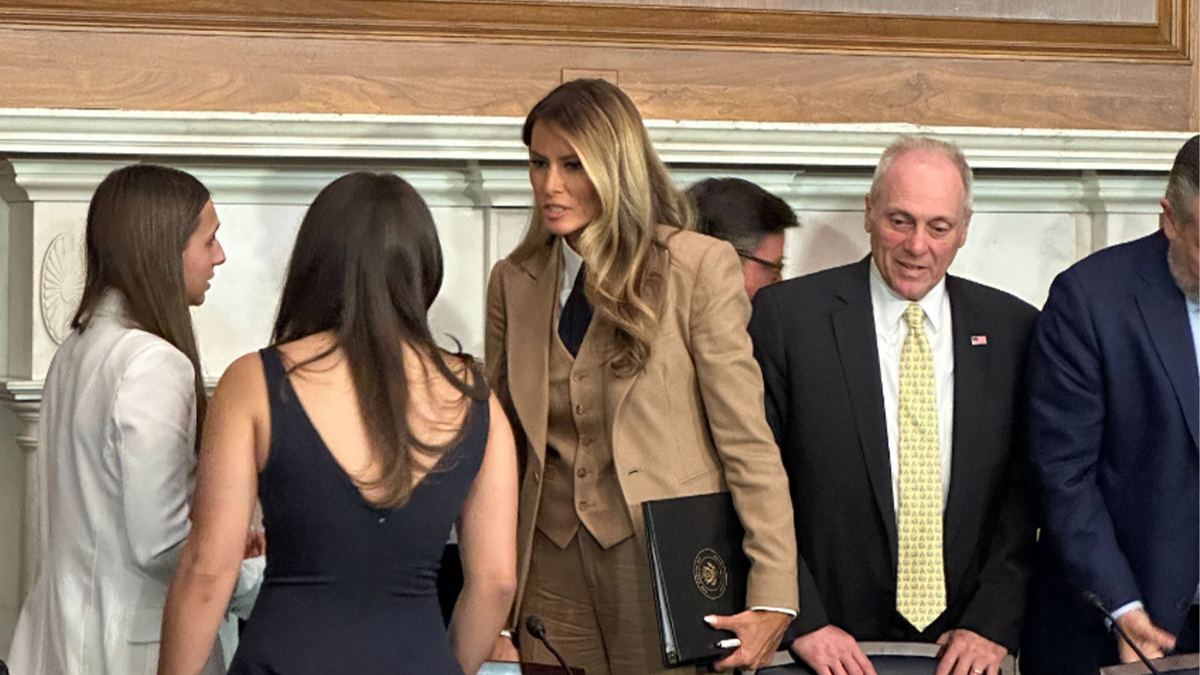

سافرت السيدة الأولى ميلانيا ترامب إلى كابيتول هيل يوم الاثنين لجمع الدعم للفوز بمائدة مستديرة. (فوكس نيوز)

سيتطلب القانون المقترح عقوبة عقوبة تصل إلى ثلاث سنوات في السجن لتبادل الصور الحميمة غير العادية التي تشمل القاصرين ومنظمة العفو الدولية. كما يتطلب عقوبة السجن لمدة تصل إلى عامين ونصف على جرائم التهديد التي تشمل القاصرين ، وسنة وسنة وعقوبة في السجن على التهديدات التي تنطوي على البالغين.

يتطلب مشروع القانون أيضًا شركات التواصل الاجتماعي مثل Snapchat و Tiktok و Instagram لحذف هذا المحتوى من أجل إدخال إجراءات لإزالة هذا المحتوى في غضون 48 ساعة من الضحايا.

طالب في المدرسة الثانوية ، حذر أولياء الأمور من تهديد صورة Deepfark العارية

تحدثت السيدة الأولى ميلانيا ترامب في كابيتول هيل لأول مرة منذ عودتها إلى البيت الأبيض ، حيث شاركت في مناقشة مائدة مستديرة بين المشرعين وضحايا الاباحية للانتقام والمنتخب من الذكاء الاصطناعى.

وقالت ميلانيا ترامب في 3 مارس: “أنا معك اليوم بهدف مشترك لحماية شبابنا من الأذى عبر الإنترنت”.

قال المؤسس المشارك للمؤسس والمهندس المعماري لـ ETERNOS.Life أندي Locascio (في بناء التوأم الرقمي الأول) إن فعل “Take It” هو “تفكير” ، لكن من غير الواقعي تمامًا افتراض أنه فعال. يقول إن الكثير من صناعة AI Deepfark يتم توفيرها من مواقع لا يغطيها القانون الأمريكي ، ومن المحتمل أن يؤثر القانون على جزء صغير فقط من مواقع الويب التي تنتهكها.

يراقب خبير الأمن الوطني بول تشارري الفيديو التشغيلي بواسطة BuzzFeed باستخدام المخرج Jordan Peel (على الشاشة R). (روب ريفر/AFP عبر Getty Images)

كما أشار إلى أن تقنية استنساخ الكلام من النصوص ستسمح بإنشاء “مزيفة مثالية”. على الرغم من أن معظم مقدمي الخدمات الرئيسيين لديهم ضوابط مهمة معمول بها لمنع إنشاء Fakes ، إلا أن Locasasio أخبر Fox News Digital أن بعض مقدمي الخدمات التجارية يتم خداعهم بسهولة.

علاوة على ذلك ، قال Locascio إن أي شخص لديه إمكانية الوصول إلى وحدة معالج رسومية قوية بشكل معقول (GPU) يمكنه بناء نموذج صوتي خاص به يمكن أن يدعم “الاستنساخ”. تتطلب بعض الخدمات المتاحة أقل من 60 ثانية من الصوت لإنشاء هذا. يتم تحرير المقاطع باستخدام البرامج الأساسية وأكثر إقناعًا.

أعضاء مجلس الشيوخ الديمقراطيين الذين يستهدفون منتحلو Deepfark الرسميين الأوكرانيين على تكبير المكالمة: تقرير

وقال لـ Fox News Digital: “لقد تغير نموذج واقعية الصوت والفيديو. يجب على الجميع الآن أن يفترضوا أن ما يرونه مزيف حتى يثبت أنه حقيقي”.

هناك القليل من التوجيه الجنائي حول الذكاء الاصطناعي Deepfakes ، لكن المحامي داني كارون يقول إنه يقال إن الضحايا ما زالوا يتابعون المطالبات المدنية ويكونون مؤهلين لتلقي أضرار مالية.

يشير كتابه القادم ، “دليل العافية القانوني لمحاميك المحبوب: قتال العالم الذي يحاول خداعك” ، إلى أن AI Deepfake يقع في قوانين خسارة الشرف التقليدية ، وخاصة خسائر الشرف ، بما في ذلك نشر البيانات الخاطئة من خلال الأدب ، التصوير الفوتوغرافي ، الصوت ، الفيديو).

تعرض هذه الصورة المصورة ، التي التقطت في 30 يناير 2023 ، شاشة هاتف تعرض بيانًا من مدير سياسة الأمان في Meta. (Olivier douliery/AFP عبر Getty Images)

لإثبات خسارة شرف ، يجب على المدعي تقديم أدلة ومناقشة بشأن بعض العناصر التي تلبي التعريف القانوني للتشهير وفقًا لقانون الولاية. العديد من الدول لديها معايير مماثلة لإثبات الشرف والخسارة.

على سبيل المثال ، بموجب قانون فرجينيا ، Deppv. كما هو الحال مع Hehd Tolil ، كان على فريق الممثل جوني ديب الوفاء بالعوامل التالية التي شكلت خسارة:

- أدلى المدعى عليه أو نشر بيانًا.

- كان البيان حول المدعي

- كان البيان معنى شائلا للمدعين.

- تم تصميم المعنى التشهيري وتهدف من المدعى عليه

- قد تطور الظروف المحيطة بالنشر معنى الشرف والخسارة لأولئك الذين يرون ذلك.

“إلى أن تعرف ماهية القانون وخسارة الاستهلاك ، لا يمكنك أن تستنتج أن شيئًا ما هو خسارة انخفاض.

أخبر كارون فوكس نيوز الرقمية أن مطالبات الذكاء الاصطناعي Deepfake يمكن أن تقودها أيضًا انتهاكات لقوانين الخصوصية وقوانين التعدي على ممتلكات الغير والمقالين المدنيين وحقوق الدعاية.

القضاة الفيدراليون يمنعون قانون كاليفورنيا الذي يحظر العميق في الانتخابات

الصورة السريالية لبروس ويليس هي في الواقع ريشة عميقة أنشأتها شركة روسية تستخدم الشبكات العصبية الاصطناعية. (كعكة عميقة عبر رويترز)

“إذا تبنى توم هانكس مؤخرًا صوته للترويج لخطط طب الأسنان ، فهو يضغط على اسم شخص ما ، وصورته ، وشبه ، وفي هذه الحالة ، يبيع الصوت ، من أجل الترويج أو استخلاص الدعاية من شخص آخر.

لسوء الحظ ، يمكن أن تنشأ المشكلات إذا لم يتمكن المدعي من تحديد من قام بإنشاء الفراء العميق ، أو إذا كان الجاني في بلد آخر. في هذا السياق ، قد يضطر أولئك الذين يسعون إلى متابعة قضية خسارة الشرف إلى توظيف خبير ويب للعثور على مصدر المحتوى.

إذا كان الفرد أو الكيان دوليًا ، يصبح هذا قضية مكان. حتى إذا تم العثور على شخص ما ، يجب على المدعي أن يقرر إجابة هذه الأسئلة.

- هل يمكن للأفراد تقديمها؟

- هل ستساعد الدول الأجنبية في الترويج لهذا؟

- هل سيظهر المدعى عليه أمام المحكمة؟

- هل لدى المدعي فرصة معقولة لجمع المال؟

إذا كانت الإجابة على بعض هذه الأسئلة هي لا ، فإن استثمار الوقت والموارد المالية اللازمة لمتابعة هذا الادعاء قد لا يستحق ذلك.

“حقوقنا فعالة بنفس القدر من القدرة على تطبيقها مثل براءات الاختراع. يقول الناس ،” لدي براءة اختراع لذا فأنا محمي “. لا ، أنت ذي قيمة مثل براءة الاختراع يمكن أن تجبرها.

انقر هنا للحصول على تطبيق Fox News

ساهم بروك سيندمان وإيما كولتون من فوكس نيوز في هذا التقرير.